TL;DR Telegram

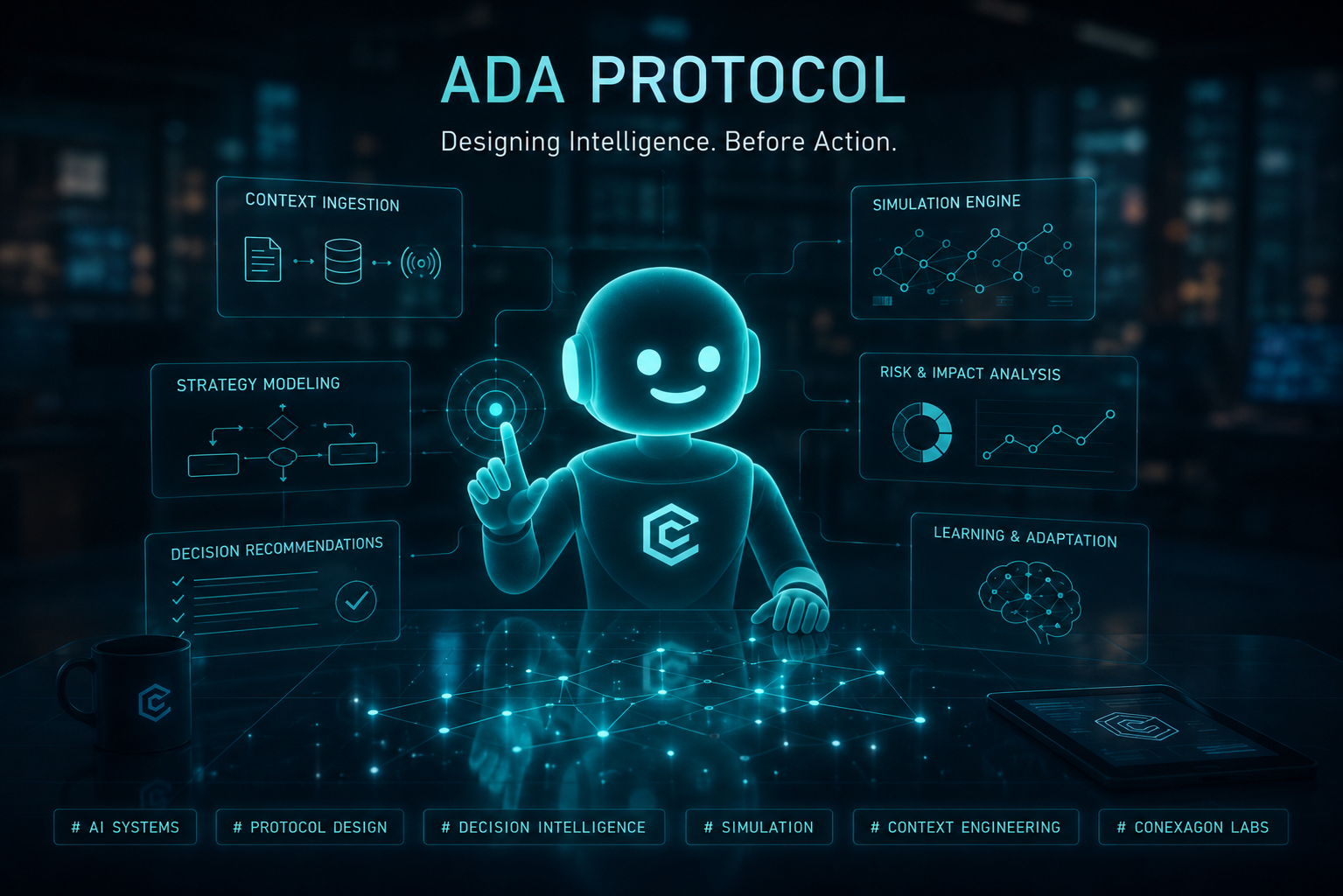

ADA Protocol ist unser Versuch, autonome AI-Systeme langsamer an der richtigen Stelle und schneller an der richtigen Stelle zu machen: erst simulieren, dann bewerten, dann kontrolliert ausführen.

Zwischen Demo Und Betrieb Liegt Ein System

In den letzten Monaten war es erstaunlich leicht, beeindruckende Agenten-Demos zu bauen. Ein Modell bekommt ein Ziel, ein paar Tools, etwas Speicher, vielleicht noch einen Loop - und plötzlich wirkt Software, als würde sie selbstständig arbeiten.

Das ist faszinierend. Und gleichzeitig fühlt es sich für ernsthafte Systeme oft unvollständig an.

Denn sobald ein Agent nicht nur schreibt, sucht oder zusammenfasst, sondern reale Workflows berührt, verändert sich die Frage. Dann geht es nicht mehr darum, ob ein Modell etwas kann. Es geht darum, ob wir verstehen, was passiert, bevor etwas passiert. Ob wir Alternativen sehen. Ob wir nachvollziehen können, warum ein Pfad gewählt wurde. Ob wir eingreifen können, bevor aus einer guten Absicht ein operatives Problem wird.

ADA Protocol entsteht genau aus dieser Lücke zwischen Demo und Betrieb.

Das Problem: Viele Agenten Handeln Zu Früh

Viele heutige agentische AI-Systeme sind um Ausführung herum gebaut. Ein Ziel wird zerlegt, Aufgaben werden erstellt, Tools werden aufgerufen, Ergebnisse werden beobachtet, der nächste Schritt folgt. Das kann produktiv sein. Aber es führt auch zu einem Muster, das uns in Projekten immer wieder beschäftigt: Das System handelt, bevor es seine eigenen Handlungsoptionen ausreichend verstanden hat.

Ein Agent kann eine E-Mail schreiben, ein CRM aktualisieren, eine API aufrufen oder Leads neu verteilen. Technisch ist das oft nicht der schwierige Teil. Schwieriger ist die Frage, ob diese Aktion in diesem Kontext wirklich die beste war.

Was wäre passiert, wenn der Agent eine andere Strategie gewählt hätte? Welche Nebenwirkungen hätte ein anderer Pfad gehabt? Welche Datenqualität lag der Entscheidung zugrunde? Welche Grenzen sollten gelten? Und welche Entscheidung hätte ein Mensch gerne gesehen, bevor sie in Produktion landet?

Wenn diese Fragen erst nach der Ausführung gestellt werden, ist das System zwar autonom, aber nicht besonders kontrolliert.

Die Kernidee: Simulation Vor Ausführung

ADA Protocol basiert auf einer einfachen Verschiebung: Autonomie sollte nicht mit Ausführung beginnen, sondern mit Simulation.

Statt direkt einen Tool-Aufruf oder eine Entscheidung auszulösen, erzeugt ADA mehrere mögliche Pfade. Diese Pfade werden als Szenarien betrachtet: Was würde passieren, wenn Strategie A gewählt wird? Wie verhält sich Strategie B unter Kapazitätsgrenzen? Welche Variante reduziert Risiko, welche maximiert Geschwindigkeit, welche lässt sich am besten erklären?

Erst danach entsteht ein Vorschlag für kontrollierte Ausführung.

Das klingt unspektakulär. Genau das mögen wir daran. Gute Systeme sind oft nicht laut. Sie schaffen einen Raum, in dem Entscheidungen vor ihrer Realität überprüfbar werden.

Ein Beispiel: Lead Routing

Nehmen wir ein einfaches, aber realitätsnahes Szenario: Eine Bank möchte eingehende Leads besser auf Beraterinnen und Berater verteilen. Klassische Automatisierung würde Regeln definieren und ausführen. Ein Agent könnte sogar dynamisch entscheiden, wer welchen Lead bekommt.

ADA fragt vorher: Welche Routing-Strategien kommen infrage?

Eine Strategie verteilt nach aktueller Kapazität. Eine andere priorisiert Spezialisierung. Eine dritte optimiert auf erwartete Reaktionszeit. In der Simulation werden diese Strategien gegeneinander gehalten: Kapazität, Antwortzeiten, mögliche Conversion, Fairness, Eskalationen, Guardrails.

Das Ergebnis ist nicht einfach ein magischer AI-Entscheid. Es ist ein bewerteter Pfad mit Begründung, Grenzen und Beobachtbarkeit.

Genau darin liegt für uns der Unterschied zwischen Automatisierung und Entscheidungssystem.

Das Mission Board

Aus dieser Arbeit ist das Bild des Mission Boards entstanden.

Wir wollten keine Black Box bauen, die im Hintergrund "agentisch" wirkt. Wir wollten eine Oberfläche, in der Aufgaben sichtbar werden. Eine Mission beginnt geplant. Dann wird sie simuliert. Danach werden Ergebnisse verglichen und bewertet. Erst wenn der Pfad plausibel ist, wird kontrollierte Ausführung möglich.

Planned. Simulating. Evaluated. Ready to Execute.

Das Mission Board ist absichtlich leichtgewichtig gedacht, eher wie ein technisches Kanban für AI-Missionen als wie ein überladenes Enterprise-Dashboard. Der wichtige Punkt ist nicht die Oberfläche selbst. Der wichtige Punkt ist die Haltung: AI-Entscheidungen sollten einen sichtbaren Lebenszyklus haben.

Menschen sollen nicht jeden Schritt manuell machen müssen. Aber sie sollen verstehen können, welche Optionen das System gesehen hat, warum eine Option bevorzugt wurde und wo Grenzen gesetzt sind.

Warum Kontext Entscheidend Ist

Contexagon hat eine lange Geschichte mit kontextuellen Systemen. Pulsar VX zum Beispiel ist keine reine Content-Plattform. Es geht darum, Räume, Objekte, Besucherinteraktionen, Medien, Sensorik und Betriebslogik in einen Zusammenhang zu bringen. Erst durch diesen Kontext wird ein digitales Erlebnis steuerbar.

Bei ADA ist der Gedanke ähnlich, nur in einer anderen Domäne.

Ein AI-System ohne Kontext kann beeindruckend formulieren, aber schlecht abwägen. Es kennt vielleicht ein Ziel, aber nicht die betrieblichen Abhängigkeiten. Es sieht einen Tool-Aufruf, aber nicht die Prozessgeschichte. Es erzeugt eine Antwort, aber nicht zwingend ein belastbares Betriebsmodell.

Deshalb denken wir bei ADA nicht nur über Agenten nach. Wir denken über Context Engineering nach: Welche Informationen braucht ein System, um seine Optionen sinnvoll zu simulieren? Welche Beobachtungen müssen live verfügbar sein? Welche Guardrails sind fachlich, welche technisch, welche organisatorisch?

Kontrollierte Autonomie Statt Menschenersatz

ADA Protocol ist nicht aus dem Wunsch entstanden, Menschen aus Prozessen zu entfernen.

Eher im Gegenteil. Je autonomer Systeme werden, desto wichtiger wird gute menschliche Kontrolle. Nicht Kontrolle im Sinne von Mikromanagement. Sondern Kontrolle im Sinne von Transparenz, Verantwortung und Eingriffsfähigkeit.

Wir glauben nicht, dass jedes Problem dadurch besser wird, dass ein Agent schneller handelt. Manchmal entsteht der eigentliche Fortschritt dadurch, dass ein System mehrere Möglichkeiten ruhig durchspielt und Menschen eine bessere Entscheidungsgrundlage gibt.

Das ist weniger spektakulär als "vollautonom". Aber es ist näher an dem, was Unternehmen wirklich brauchen, wenn AI in produktive Workflows hineinwächst.

AI Lab Als Arbeitsmodus

ADA entsteht im Contexagon AI Lab nicht als fertiges Produkt von der Stange, sondern als Forschungs- und Entwicklungsstrang aus echten Fragen.

Wie sieht ein AI-natives System aus, das nicht nur Prompts verwaltet, sondern Entscheidungen vorbereitet? Wie modelliert man Missionen? Wie protokolliert man Simulationen? Wie macht man Agentenverhalten sichtbar, ohne Teams mit Telemetrie zu erschlagen? Wie trennt man Vorschlag, Freigabe und Ausführung sauber?

Intern nennen wir manche dieser Werkzeuge halb im Scherz einen Raketenwerfer für Ideen. Nicht, weil alles schneller und größer werden muss. Sondern weil kleine Teams mit den richtigen Systemen sehr weit denken, schnell bauen und trotzdem sorgfältig bleiben können.

Das ist die eigentliche Spannung, die uns interessiert: hohe Geschwindigkeit, aber mit Systemdisziplin.

Wohin ADA Sich Entwickelt

ADA Protocol ist im Entstehen. Es ist keine fertige Enterprise-Suite, kein magischer Agentenbaukasten und keine Abkürzung an Architektur vorbei.

Im Moment ist es eine Protokollschicht, ein Mission-Board-Konzept und eine Reihe von technischen Experimenten rund um Simulation, Evaluation, Observability und kontrollierte Ausführung. Einige Ideen sind schon konkret. Andere sind noch Skizzen, die wir mit frühen Szenarien und Kundenfragen schärfen.

Aber die Richtung ist klar: Wenn AI-Systeme mehr Verantwortung in Workflows übernehmen, müssen sie lernen, Entscheidungen vor ihrer Ausführung zu prüfen.

Nicht aus Angst vor Autonomie.

Sondern weil Autonomie ohne Foresight nur Bewegung ist.